ChatGPTなどの台頭で一気に知名度を上げた大規模言語モデル(Large Language Model、以下、LLM)は、チャットボット、仮想アシスタント、コンテンツ生成といった幅広い用途に使用できるため、自然言語処理(NLP)においてますます重要性を増しています。しかし、大量の学習データと高い計算量が必要なため、LLMの学習や実装にはまだまだ困難が付きものです。さらに、一部のLLMはバイアスや有害性などの問題に悩まされることがあり、特定の文脈においては有用に利用できない場合もあります。

2023年2月、メタから新しいLLMが発表されました。このフレームワークはLLaMA(Large Language Model Meta AI)と呼ばれ、他の最先端モデルを凌駕する性能を持ちながら、よりアクセスしやすく、透明性の高いモデルであることが示されています。このブログ記事では、メタから発表された論文をもとにLLaMAモデルの特徴や能力を探りたいと思います。

論文タイトル:LLaMA: Open and Efficient Foundation Language Models

発行日:2023年 2月27日

URL:https://arxiv.org/pdf/2302.13971.pdf

・LLaMAについて

・LLaMAがGPT-3よりも優れた性能を発揮できたワケ

・LLaMAがどのようにリスクやバイアスの問題にアプローチしているのか

メタから発表されたLLaMAフレームワークは大規模な言語モデルをトレーニングするための新しいアプローチであり、他のフレームワークとは異なるいくつかの重要な特徴を備えています。LLaMAフレームワークの最も重要な特徴の1つは、一般に公開されているトレーニングデータを使用することです。独自のデータセットに依存する他のフレームワークとは異なり、公開されているデータセットのみを使用してトレーニングされています。このため、研究者や実務家にとって、モデルの透明性が高く、アクセスしやすくなっています。また、オープンソースであるため、研究者はコードにアクセスするだけで、一般に公開されているデータを使用し、独自のデータセットに頼ることなく、最先端の性能を持つ大規模言語モデルを開発することができます。

LLaMAフレームワークのもう一つの大きな特徴は、モデルサイズが豊富なことです。70億〜650億のパラメータまでの幅広いモデルサイズが提供されており、ユーザーは特定のニーズに合ったモデルを選択することができます。この柔軟性こそが、計算資源やデータ要件が異なる研究者や実務家にとって特に有用であると言われています。

LLaMAフレームワークはまた、言語モデリングで一般的に使用されるものより多くのトークンでトレーニングを行うという、新しいトレーニング戦略を採用しています。具体的には下記のような公開データソースから抽出した1.4兆個のトークンで学習したと論文に書かれています。

・コモン・クロールでスクレイピングしたWebページ

・GitHub のオープンソースリポジトリ

・ウィキペディア(20種類の言語)

・プロジェクト・グーテンベルクのパブリックドメインの書籍

・ArXivにアップロードされた科学論文のLaTeXソースコード

・Stack Exchangeウェブサイトの質問と回答

このように、大量のトークンでモデルを訓練することで、より幅広い言語パターンを捉え、様々なNLPタスクでのパフォーマンスを向上させることができるのです。

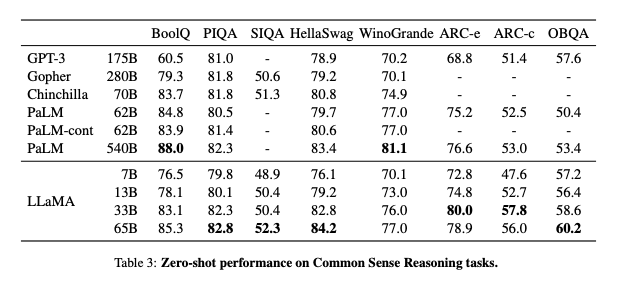

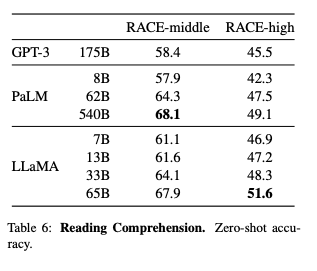

実際に、LLaMAモデルは、GPT-3、Chinchilla、PaLMといった既存のLLMの中で最も優れたものと比較して、競争力のある性能を有していると論文には書かれています。

参考:LLaMAと他のLLMの比較

(出典:LLaMA: Open and Efficient Foundation Language Models)

AIの活用提案から、ビジネスモデルの構築、AI開発と導入まで一貫した支援を日本企業へ提供する、石角友愛氏(CEO)が2017年に創業したシリコンバレー発のAI企業。

社名 :パロアルトインサイトLLC

設立 :2017年

所在 :米国カリフォルニア州 (シリコンバレー)

メンバー数:17名(2021年9月現在)

パロアルトインサイトHP:www.paloaltoinsight.com

お問い合わせ、ご質問などはこちらまで:info@paloaltoinsight.com

2010年にハーバードビジネススクールでMBAを取得したのち、シリコンバレーのグーグル本社で多数のAI関連プロジェクトをシニアストラテジストとしてリード。その後HRテック・流通系AIベンチャーを経てパロアルトインサイトをシリコンバレーで起業。東急ホテルズ&リゾーツのDXアドバイザーとして中長期DX戦略への助言を行うなど、多くの日本企業に対して最新のDX戦略提案からAI開発まで一貫したAI・DX支援を提供する。2024年より一般社団法人人工知能学会理事及び東京都AI戦略会議 専門家委員メンバーに就任。

AI人材育成のためのコンテンツ開発なども手掛け、順天堂大学大学院医学研究科データサイエンス学科客員教授(AI企業戦略)及び東京大学工学部アドバイザリー・ボードをはじめとして、京都府アート&テクノロジー・ヴィレッジ事業クリエイターを務めるなど幅広く活動している。

毎日新聞、日経xTREND、ITmediaなど大手メディアでの連載を持ち、 DXの重要性を伝える毎週配信ポッドキャスト「Level 5」のMCや、NHKラジオ第1「マイあさ!」内「マイ!Biz」コーナーにレギュラー出演中。「報道ステーション」「NHKクローズアップ現代+」などTV出演も多数。

著書に『AI時代を生き抜くということ ChatGPTとリスキリング』(日経BP)『いまこそ知りたいDX戦略』『いまこそ知りたいAIビジネス』(ディスカヴァー・トゥエンティワン)、『経験ゼロから始めるAI時代の新キャリアデザイン』(KADOKAWA)、『才能の見つけ方 天才の育て方』(文藝春秋)など多数。

実践型教育AIプログラム「AIと私」:https://www.aitowatashi.com/

お問い合わせ、ご質問などはこちらまで:info@paloaltoinsight.com

|

|

※石角友愛の著書一覧

毎週水曜日、アメリカの最新AI情報が満載の

ニュースレターを無料でお届け!

その他講演情報やAI導入事例紹介、

ニュースレター登録者対象の

無料オンラインセミナーのご案内などを送ります。